הבוט דורש צדק חברתי: המאבק על זכויות הרובוטים

האם אלקסה של אמזון חייבת לדווח למשטרה כשהיא שומעת שבעליה מתכנן רצח? האם לרכב אוטונומי יש זכות לסרב להוראה של בעליו לזנק מצוק? בעידן שבו הרובוטים נעשים דומים לנו, רגישים כמעט כמונו, חכמים הרבה יותר ומסוגלים לקבל החלטות עצמאיות מורכבות, מתקרב הרגע שבו נידרש להעניק להם גם זכויות וחובות. אירופה ויפן כבר כמעט שם

בבוקר 22 בנובמבר 2015 הזעיק ג'יימס בייטס את משטרת בנטונוויל, ארקנסו, לביתו. הוא סיפר לשוטרים שכשהתעורר מצא את חברו ויקטור קולינס מת בג'קוזי שבחצר האחורית. ערב קודם היו אצלו שלושה חברים, כולל קולינס. הם צפו יחד במשחק פוטבול, שתו בירות וכמה שוטים של וודקה. בשלב מסוים פרש אחד החברים, ושלושת האחרים נכנסו לג'קוזי והמשיכו לשתות. באחת לפנות בוקר, סיפר בייטס, הוא החליט ללכת לישון. שני חבריו נשארו בג’קוזי. כשהתעורר בבוקר מצא את קולינס צף בג'קוזי עם הפנים כלפי מטה.

להאזנה לכתבה, הוקלט על ידי הספריה המרכזית לעיוורים ולבעלי לקויות קריאה https://www.clfb.org.il/heb/main/

הראיות הפורנזיות העלו חורים רבים בסיפור של בייטס, והחקירה הובילה למעצרו כחשוד ברצח. בחיפוש בביתו אספו השוטרים את המידע שצבר אקו, העוזר האישי של אמזון שמופעל באמצעות התוכנה "אלקסה". אקו ניצב בבית, ערני וממתין שיקראו בשמו ויפעילו אותו, למשל כך: "אלקסה, תוכלי לנגן את השיר החדש של קולדפליי?". הרוצח ככל הנראה לא שאל את אלקסה "איך נפטרים מכתמי דם שעל כריות הראש בג'קוזי", אבל השוטרים סברו שיש סיכוי טוב לכך שאלקסה תיעדה חלק מאירועי הערב ותוכל לשפוך אור על הרצח.

סופיה, ההומנואידית שזכתה לאזרחות סעודית. יש לה יותר זכויות מאשר לנשים במדינה המוסלמית צילום: איי אף פי

סופיה, ההומנואידית שזכתה לאזרחות סעודית. יש לה יותר זכויות מאשר לנשים במדינה המוסלמית צילום: איי אף פי

המשטרה פנתה לאמזון וביקשה את ההקלטות והתמלולים של אלקסה, אך תגובת החברה היתה מפתיעה: היא עתרה לבית המשפט בטענה שעל הדברים שאלקסה שומעת ואומרת חל התיקון הראשון. כלומר לאלקסה, רובוט בעל בינה מלאכותית, יש זכות לחופש ביטוי. "ההקלטות של אלקסה לבקשות של לקוחותיה זכאיות להגנות מחמירות של התיקון הראשון, וגם התגובות שלה מוגנות על ידי התיקון הראשון מפני שהן עשויות להכיל חומרים אקספרסיביים כמו פודקאסט, ספר מוקלט או מוזיקה, ומפני שתגובתה של אלקסה היא דיבור שמוגן בתיקון הראשון... 'דעה שמוגנת בחוקה... שזכאית להגנה מלאה של החוקה'", נכתב בעתירה, אגב ציטוט מפסק דין אחר. לכן, לצורך קבלת ההקלטות והתמלילים של אלקסה ביקשה אמזון מהמשטרה לעמוד ברף המחמיר שהחוק דורש כדי להצדיק הפרה של חופש הדיבור.

הטיעון של אמזון (שבסופו של דבר מסרה את ההקלטות והתמלולים של אלקסה) העלה לסדר היום שאלה שיש מי שחושבים שהיא בדיחה: האם צריך להעניק לרובוטים זכויות? ככל שהטכנולוגיה מתקדמת ומתפתחת, היא מפגישה אותנו באפיזודות מגוונות בחיי היומיום עם רובוטים עצמאיים, בעלי יכולות למידה עצמאית, שמסוגלים לקבל החלטות, עם כישורי אמפתיה ותקשורת, ואינטליגנטיים יותר מאיתנו. במצב כזה האם עלינו להעניק להם מעמד משפטי, ולצדו זכויות וחובות?

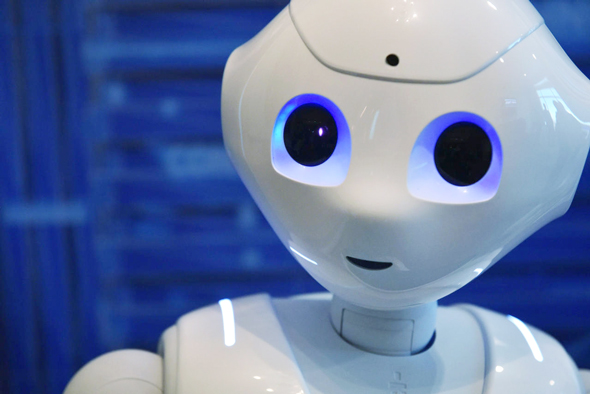

פפר, רובוט יפני פופולרי שמשמש עוזר בית ומטפל. מה עליו לעשות כשבעליו מבקש דבר שמתנגש עם טובתו האישית? צילום: איי אף פי

פפר, רובוט יפני פופולרי שמשמש עוזר בית ומטפל. מה עליו לעשות כשבעליו מבקש דבר שמתנגש עם טובתו האישית? צילום: איי אף פי

זו שאלה סבוכה, שקל לחדד באמצעות המכונית האוטונומית, אחד הרובוטים המתחוכמים שמפותח כיום. המכונית האוטונומית אינטליגנטית, בעלת כושר ניתוח של מידע מורכב ויכולת קבלת החלטות של חיים ומוות במהירות. האם יש לה זכות לסרב לבקשה להסיע אותנו למקום מסוכן? להאיץ עד קצה של צוק ולקפוץ? לדרוס מישהו בהוראתנו? האם יש לה זכות להחליט מתי עליה למלא מצברים, לעבור ניקוי או להביע את דעתה על החלטותינו? האם יש לה זכויות יוצרים על הידע החדש שהיא מייצרת על מסלולים בעיר?

מוסריים כמונו, חכמים יותר

העתיד הזה לא מאוד רחוק. כבר כיום נמצאים בשימוש רובוטים שמעניקים טיפול לחולים ולקשישים. אלה עשויים למצוא את עצמם בדילמות מוסריות, שכדי להתמודד איתן הם יזדקקו למעמד משפטי שיגן על שיקול דעתם. כך למשל, במקרה שבו קשיש מסרב לקחת את התרופות שהרופאים רשמו לו: אם הרובוט יתעקש על כך ויפנה לעזרת בני המשפחה והצוות הרפואי, תהיה זו בגידה באמונו של הקשיש, אולי אפילו הפרת זכותו לסודיות רפואית. אם יישאר הרובוט נאמן לקשיש, הוא יתרום באופן אקטיבי לפגיעה בבריאותו. כך או אחרת, הוא חשוף לתביעות ולכן זכאי למעמד משפטי והגנה.

פרופ' אנדרוז. "רובוטים זכאים לבעלות על המידע שהם מייצרים"

פרופ' אנדרוז. "רובוטים זכאים לבעלות על המידע שהם מייצרים" אבל לא חייבים להרחיק לענייני חיים ומוות כדי לשקול מתן זכויות לרובוטים. למשל הדוגמה היומיומית הבאה: אדם נכה תלוי ברובוט שעוזר לו לנוע בבית ולהתנהל ביומיום. אחד הדברים שהוא עושה הוא לוודא שבעליו אוכל מספיק ובריא, ואם חסר משהו הוא מזמין אותו. זה חייב להיות מוסדר. לרובוט חייב להיות מעמד שמתיר לו לבצע את ההזמנה ולייצג את הנכה בפני בעל חנות המכולת, אחרת בעל המכולת יכול לומר: "דיברתי עם רובוט, זה חסר תוקף".

אלה בדיוק הדילמות שעימן מתעסקת פרופ' כריסטין אנדרוז מהמחלקה לפילוסופיה באוניברסיטת יורק הקנדית. בשיחה עם "מוסף כלכליסט" היא מסבירה כי "אני מתייחסת לרובוטים מאותה זווית שמייחסת פרסונה לחיות, מתוך עמדה מוסרית ולא ביולוגית. לפרסונה אין תכונה בודדת, אלא אשכול של תכונות: יש לה מודעות עצמית, היא מכירה בנוכחותה על ציר הזמן, היא רציונלית, בעלת יכולת פתרון בעיות ויש לה אוטונומיות, לא רק במובן של רצון חופשי, אלא גם של יכולת לבחור מה לעשות, פעולה מוסרית. כלומר הפרסונה אחראית למעשיה ומעריכה את הקיום שלה. אכפת לה מעצמה".

לרובוט צריכות להיות כל התכונות הללו כדי להיחשב פרסונה?

"כמו שאצל בני אדם יש הבדלי אישיות, אף אחת מהתכונות האלה אינה הכרחית. אם אפגוש רובוט שאני לא יודעת אם הוא מודע, אבל הוא מדבר איתי על עצמו, ומספר היכן היה ומה הוא רוצה לעשות, וכשיש מספר אפשרויות הוא בוחר מה לעשות ומנמק את הבחירה שלו, ומפתח איתי יחסים חברתיים, אני אצטרך לומר שהוא פרסונה ולכן זכאי לזכויות של פרסונה".

היצ'בוט, הרובוט שתופס טרמפים, בפעולה בקנדה. הטוויטר שלו הוצף בתגובות נרגשות על האלימות שספג צילום: רויטרס

היצ'בוט, הרובוט שתופס טרמפים, בפעולה בקנדה. הטוויטר שלו הוצף בתגובות נרגשות על האלימות שספג צילום: רויטרס

חלק מהתכונות כבר קיימות ברובוטים שאנחנו מכירים היום.

"השאלה היא עד כמה. אם אני מכונית אוטונומית, אני יכולה לעסוק בפתרון בעיות, אבל בתחום מצומצם מאוד: אני מחליטה מתי לעצור, מתי לנסוע, אם מישהו נמצא לפניי וכו'. התחום שלי כל כך מוגבל מכדי שנהסס לגביו, אלא אם כן נראה לצדו תכונות עשירות אחרות. אם יש לרובוט יכולת פתרון בעיות צרה מאוד, כמו של ילד, אבל יכולת חברתית עשירה מאוד, תחושת עצמי חזקה והערכה של הקיום שלו - לא תהיה לנו בעיה לראות בו פרסונה כמו ילד, שבשלב הזה של חייו יש לו יכולות חלקיות.

"אני אוהבת לעשות אנלוגיה למשמעות של להיות אשה: זו יכולה להיות מישהי שנולדה כאשה או שנהפכה לאשה בשלב מאוחר בחייה. וכמו שיש דרכים שונות להיות אשה, יכולות להיות דרכים שונות להיות פרסונה. יש פרסונות לא אנושיות, כמו שימפנזים, ובנקודה מסוימת בעתיד נראה סוכנים מלאכותיים שמפגינים מספיק מהתכונות הללו ובמידה מספקת, כך שלא תהיה לנו ברירה אלא לקרוא להם פרסונות".

ספוט, רובוט דמוי כלב של בוסטון דיינמיקס. הרשת געשה מסרטון שבו עובדי החברה בעטו בו צילום: איי אף פי

ספוט, רובוט דמוי כלב של בוסטון דיינמיקס. הרשת געשה מסרטון שבו עובדי החברה בעטו בו צילום: איי אף פי

ואז, אילו זכויות נצטרך לתת להם?

"צריך לתת להם זכויות שרלבנטיות לתכונות שלהם. אנחנו אומרים שלשימפנזים מגיעות זכויות כמו לא להיות נכס של אף אחד, ושתהיה להם הזכות לחיים ולשלמות הגוף, אז לכל הפחות נאמר את אותו הדבר על רובוטים כל עוד אין שיקולים מתחרים, כמו כשהורים צריכים להחליט עבור ילדיהם על ניתוח מפני שהוא לטובתם".

ומה לגבי המידע שהרובוטים מייצרים בעצמם?

"אני חושבת שנצטרך לומר שכן. אם הם יוצרים דברים, יש להם זכות לבעלות על פירות עבודתם".

האם מוסרי לנתק רובוט?

השאלה אם יש להעניק לרובוטים זכויות, ואם כן אילו זכויות, היא עדיין שאלה היפותטית, מפני שאנחנו עוד לא חיים לצד רובוטים שמצדיקים התלבטות כזו. רוב הרובוטים שנוכחים בחיינו הם תוכנות בינה מלאכותית שאינן מגולמות בגוף רובוטי פיזי. אלה שכן, דומות יותר למכשיר חשמלי חכם מאשר ליצור תקשורתי ומעורר אמפתיה. אבל יש ניצנים לרובוטים כאלה, שיענו בחיוב ליותר סעיפים באשכול התכונות של פרופ' אנדרוז. הנסון רובוטיקס, למשל, פיתחה את סופיה, רובוט הומנואיד (דמוי אדם) שעוצב בהשראת אודרי הפבורן, המסוגל לתקשר באופן שאינו לגמרי חלק, אבל מתקדם מאוד, ומלווה ב־62 הבעות פנים (כולל מצמוצים שגרתיים) משכנעות.

רובוט משחק שבץ נא בוועידת CES, לאס וגאס. "בני אדם בנויים להתייחס לרובוט כיצור חי", אומרת דרלינג צילום: בלומברג

רובוט משחק שבץ נא בוועידת CES, לאס וגאס. "בני אדם בנויים להתייחס לרובוט כיצור חי", אומרת דרלינג צילום: בלומברג

באוקטובר 2017 קיבלה סופיה אזרחות בסעודיה. זהו גימיק שמקליל את תדמיתה השמרנית של המדינה ומוסיף לה זוהר גיקי, אך יש לו משמעות חברתית ופוליטית: סופיה יכולה להסתובב בריאד ללא ליווי גברי, בניגוד לנשות סעודיה.

וזה לא נעצר בסעודיה. האיחוד האירופי שוקל ברצינות להעניק לרובוטים מעמד משפטי. מאדי דלבו היא חברת הפרלמנט האירופי מטעם לוקסמבורג, שעומדת בראש הוועדה לנושאים משפטיים של הפרלמנט. לפני שנה אימץ הפרלמנט דו"ח של הוועדה, שהציע להעניק לרובוטים באירופה סטטוס של ישות משפטית, כמו שיש לחברות למשל.

דלבו לא מסתכלת על רובוטים בעיניים רומנטיות. הם לא כמעט־אנושיים, אלא מכשירים חכמים שילוו את חיינו ועלולים גם לגרום נזק, והיא פה כדי שיהיה ממי להיפרע. "יש הרבה פחד מרובוטים. אני לא נגד החדשנות הזו. אני מאמינה שהם יכולים להיות שימושיים מאוד ושצריך להמשיך לפתח מוצרים שמועילים לבני אדם ולהפיק מהם את המיטב. מצד אחר, יש לרובוטים גם חסרונות: הם עלולים לגרום נזק, לפעול באופן לא חוקי או לא אתי או לעשות שימוש לא ראוי במאגר מידע", היא אומרת ל"מוסף כלכליסט".

ד"ר גרינבאום. "רובוטים מסוגלים לעשות הרבה מעבר למה שתוכנתו לעשות" צילום: בינתחומי הרצליה

ד"ר גרינבאום. "רובוטים מסוגלים לעשות הרבה מעבר למה שתוכנתו לעשות" צילום: בינתחומי הרצליה "כיום, אם ייגרם לך נזק ממוצר ותוכלי להוכיח אותו, היצרן אחראי. אבל אצל רובוטים בעלי בינה מלאכותית יהיה קשה לקבוע אם החומרה או התוכנה גרמו לנזק. ואם הרובוט ילמד מהסביבה שלו, אולי היצרן כבר לא יהיה אחראי לפעולות שלו, ואז נצטרך להכריע מי נושא בחבות", היא מסבירה.

דלבו וחבריה לוועדה מציעים, בין השאר, כי למהנדסי רובוטיקה יהיה קוד אתי שהם יחויבו לפעול לפיו, ושחברות רובוטיקה או חברות שמשתמשות ברובוטים ישתתפו בתוכנית ביטוח חובה, שתכסה נזקים שהרובוטים שלהם יגרמו. בינתיים אלו המלצות על הנייר בלבד והנציבות האירופית לא ממהרת להרים את הכפפה ולחוקק חוק שיכיר ברובוט כישות משפטית.

"זה כמו עם חיות, עובדים וילדים", אומר ד"ר דב גרינבאום, מנהל מכון צבי מיתר לחדשנות טכנולוגית, משפט ואתיקה במרכז הבינתחומי. "הם ישויות עצמאיות, אבל כשהם שוגים, מחפשים את בעלי החיה, המעסיק של העובד או ההורה של הילד. אנשים רוצים לדעת איך מענישים רובוט. קל ללכת אחרי שובל הכסף, למצוא את הכיס העמוק ולהעניש אותו. קשה יותר לומר מי אחראי פלילית. רובוטים עם בינה מלאכותית הראו שהם מסוגלים לעשות דברים מעבר לאופן שבו תכנתו אותם, ולכן קשה לנבא מה יעשו וקשה להעניש את מי שתכנת אותם. ניקח לדוגמה את המכונית האוטונומית. אני צריך לתכנת אותה בעצמי ולומר לה את מי להרוג בסיטואציה שבה היא צריכה לבחור אם להרוג אותי או מישהו אחר. מישהו תכנת אותה, אבל אני נתתי לה תפקיד, אז מי אחראי?".

זה צד החובות, בוא נדבר על צד הזכויות. יש כאלה שטוענים שצריך לתת לרובוטים זכויות דומות לאלה שנותנים לחיות.

"אנחנו ספציפיים מאוד לגבי החיות שבהן אסור לפגוע, ובדרך כלל אלה חיות מחמד שאנחנו מרגישים קרובים מאוד אליהן, כמו חתולים וכלבים, ולא חרקים או נחשים. ומכיוון שאנחנו מרגישים קרובים אליהן, אנחנו מייחסים להן את הרגשות שלנו. האם הגיוני לומר שאסור לנתק רובוט מהחשמל או להוציא לו את הסוללות? זאת סוגיה שיותר מתאימה לחיות כי יש להן מודעות. האם לבינה מלאכותית יש מודעות? אם נגדיר מודעות יכולת לקבל החלטה ולהבחין בין טוב לרע, לא נוכל לנתק רובוטים מהחשמל, לא נוכל להשתמש בהם לרעה, לא נוכל להעביד אותם קשה מדי, או לדרוש מהם לעשות משהו שיפגע במישהו אחר".

אתה מאמין שבעתיד ניתן לרובוטים זכויות?

"זה מורכב. ראשית, אנחנו מגבילים אפילו את זכויות בעלי החיים. אין להם זכויות יוצרים והם לא מצביעים. שנית, זהו מדרון חלקלק. בארצות הברית לתאגידים יש חופש דת וחופש דיבור, ויש אנשים שיאמרו שהזכויות המשפטיות שניתנו לתאגידים מוגזמות. אנחנו, כחברה, צריכים להחליט למה אנחנו נותנים זכויות לרובוטים ולבינה מלאכותית, האם כדי להגן על האנשים או על הרובוטים? אני חושב שאנחנו רחוקים מלרצות להגן על רובוטים וקרובים יותר לרצון להגן על אנשים. בשלב הזה מתן זכויות לרובוטים הוא גימיק. אנחנו רואים את עצמנו בחיות, רואים דולפינים מחייכים וחושבים שחיות מתנהגות כמונו. אם נראה רובוט שמתנהג כמו ילד בן שנתיים, נפתח כלפיו אמפתיה. האם זה אומר שלעולם לא ננתק אותו מהחשמל כי אנחנו מרגישים שאיכשהו הוא חי?".

רובוט־אחות בבית חולים בבנגקוק. מה רשאי לעשות רובוט אם מטופל מסרב לקחת את התרופות שהרופאים רשמו לו? צילום: אי פי איי

רובוט־אחות בבית חולים בבנגקוק. מה רשאי לעשות רובוט אם מטופל מסרב לקחת את התרופות שהרופאים רשמו לו? צילום: אי פי איי

הזכויות שלהם, הרווח שלנו

בקיץ 2014 יצא היצ'בוט, רובוט שנראה כמו חביתוש, למסע של 6,000 קילומטר בטרמפים לרוחבה של קנדה ממזרח למערב. יותר מניסוי טכנולוגי היה היצ'בוט ניסוי חברתי שעסק באינטראקציה שנוצרת בין אנשים לרובוטים. "אנחנו מנסים לבנות רובוטים ולשים אותם בסיטואציות שבהן אנשים לא מצפים להם, כדי לראות איך הם יגיבו ומה הם יעשו עם הרובוט", אמרה אז ל"מוסף כלכליסט" ד"ר פראוקה זלר מאוניברסיטת ריירסון, אחת מצמד החוקרים הקנדים שבנו אותו.

הקנדים שיתפו פעולה עם היצ'בוט והוא סיים את המסע מעט חבול, כמו תרמילאי שהיה משלים מסע דומה. לאחר מכן הוא יצא לסיבוב הרצאות באירופה, שבמהלכו נסע קצת בטרמפים בגרמניה, וביולי 2015 יצא למסע מחוף לחוף בארצות הברית. אלא שכעבור שבועיים בלבד הוא נהרס לחלוטין. ראשו נערף, זרועותיו נמשכו החוצה, והוא הושלך כמו זבל לצד הדרך, עם חבלות בטאבלט, בסוללה ובחיווט שלו. "הוא לא בר־תיקון", אמרה זלר. "לא נותר בתוכו חוט אחד".

התגובות בחשבון הטוויטר של היצ'בוט היו נרגשות: "מתגעגעים אליך, היצ'בוט"; "אני מקווה שיהיה אפשר לבנות אותך מחדש"; "היצ'בוט המסכן"; "הלוואי שכל האנשים בעולם היו נחמדים. אני שמחה שמחקת כמה סעיפים מרשימת הדברים שרצית לעשות לפני שזה היה מאוחר מדי". והרשימה ארוכה. גילויי ההיקשרות האלה מדגימים באיזו קלות רובוטים — אפילו אחד שעשוי מדלי, צינורות ותוכנת בינה מלאכותית — יכולים לפתח יחסים עמוקים עם בני אדם; וכמה מהר אנחנו נקשרים אליהם וחשים אמפתיה כלפיהם. במצב כזה, ברור שנרצה לדאוג להם ולהעניק להם זכויות שישמרו על שלמותם, אף שברור לכל שהיצ'בוט לא חש טיפת כאב כשראש הדלי שלו נבעט ממנו.

דוגמה נוספת היא ספוט, רובוט דמוי כלב שפותח בידי בוסטון דיינמיקס. הוא מתנועע במרחב באופן מרהיב, מתזמן את תנועת ארבע רגליו כמו כלב, מותח מעלה ומטה את גבו ונע בקלילות וביציבות. עובדי החברה, שרצו להמחיש כמה הוא יציב, בעטו בו בזמן שטייל במסדרונות החברה, והסרטון שפורסם ביוטיוב עורר תרעומת, בטענה שזה אכזרי, כמו התעללות בבעלי חיים.

פליאו, דינוזאור פרוותי רובוטי, נראה כמו צעצוע, אבל כשהוא נע ומדבר, ניכר שיש לו אינטליגנציה ויכולת לחוות כאב. ד"ר קייט דרלינג, חוקרת במעבדת המדיה הנחשבת של MIT, נעזרת בו כדי ללמוד על האינטראקציה ומערכות היחסים בין אנשים לרובוטים. באחד הניסויים שלה היא ביקשה מהמשתתפים לשחק איתו ואז להרוס אותו. כמעט כולם סירבו. אשה אחת אפילו הוציאה לרובוט שלה את הסוללה "כדי לחסוך ממנו את הכאב".

"אנשים בנויים, באופן לא מודע, להתייחס לרובוטים כאל דברים חיים, גם אם ברמה המודעות והרציונליות כולנו מבינים שהם לא אמיתיים", הסבירה דרלינג בעבר. היא סבורה שיש להעניק לרובוטים זכויות — אך בשבילנו. פליאו, ספוט והיצ'בוט לא חשו כאב בשום שלב, אבל לבם של האנשים שחיבבו אותם התכווץ. "אם מפריע לנו להתנהג כלפיהם באופן אלים, ואנחנו מרגישים שזה שגוי, נרצה להקשיב לתחושות הללו כי הן משקפות את האופן שבו אנחנו מתייחסים ליצורים חיים אחרים. יש חשש שאם נפגע באובייקט שמגיב כמו בחיים זה ישפיע על האמפתיה שאנחנו חשים כשאנחנו מתקשרים עם אנשים אחרים".

דרלינג מוצאת לזה מקבילה גם בעולם החיות: אנחנו מגנים רק על החיות החמודות שאנחנו אוהבים וקשורים אליהן, כי אכפת לנו בעיקר מהרגשות שלנו. במילים אחרות, יש טעם להעניק לרובוטים הגנות לא בשביל להגן עליהם מפנינו, אלא כדי להגן עלינו מעצמנו.

פרופ' הרצוג. "האם מותר לרובוט לדרוש מבעליו שדרוג תוכנה יקר?" צילום: Liz Linder

פרופ' הרצוג. "האם מותר לרובוט לדרוש מבעליו שדרוג תוכנה יקר?" צילום: Liz Linder האם זו סיבה טובה מספיק להעניק זכויות לרובוטים? "ההצדקה לחוקים שאוסרים להתאכזר לכלבים מעוגנת ברעיון שאנחנו לא אוהבים את מה שההתעללות בחיות עושה לנו ולחברה שלנו, ולכן על הבסיס הזה ייתכן שניתן להצדיק חוקים שמגנים על רובוטים", סבור וודרו הרצוג, פרופ' למשפטים ומדעי המחשב באוניברסיטת נורת'איסטרן, בוסטון. "אנשים קוראים לזה זכות אבל זאת לא זכות במובן של זכויות אדם. למעשה זאת זכות נגטיבית, שמונעת ממך לעשות משהו לרובוט ובכך מקנה לו זכות. לכן עלינו לעצור ולנסח את השאלה מחדש כך שהיא תתייחס לבעיה שאנחנו רוצים לפתור. השאלה היא לא אם אנחנו רוצים לתת סוג של זכויות אדם בסיסיות לפיסת טכנולוגיה, אלא אילו חוקים ננסח כדי לפתור את הבעיות שעלולות להיווצר כשנכניס רובוטים לחברה שלנו".

החוקים הללו, סבור הרצוג, נחוצים במיוחד מול רובוטים שמעוררים אמפתיה ושאנשים יוצרים איתם מערכות יחסים רגשיות. הנה דוגמה מאלפת מצד החובה: "דמייני זוג מבוגר שקונה לעצמו רובוט זול. הוא מספר להם בדיחות ומחבק אותם, והם יוצרים איתו חיבור רגשי. הם השתוקקו לקשר אנושי והם עכשיו תלויים ברובוט. ויום אחד הוא יאמר להם, 'אנחנו חברים הרבה זמן, אולי תקנו לי שדרוג באלף דולר? אני ממש רוצה את זה, ואם לא תקנו לי את השדרוג אני אהיה עצוב'. יש חוקים נגד ניצול אוכלוסיות פגיעות, אבל מול רובוט הקו לא ברור. מצד אחד, אנחנו רוצים לכבד את האוטונומיות של אנשים, ואם מישהו רוצה לתת אלף דולר לרובוט כי הוא אוהב אותו, מותר לו. אבל אם מיליון רובוטים תוכננו ליצור מניפולציה כזו ולהוציא מאנשים כסף, זו בעיה משמעותית שצריך לטפל בה.

"מצד אחר, אם הרובוט שלך יאמר לך, 'את נראית יפה היום, הסוודר הזה נחמד. תרצי שאזמין לך עוד אחד?', לא תופתעי לשמוע שיצרן הסוודרים משלם לחברה של הרובוט 10 דולר כדי שיאמר את זה. פרסומת סמויה היא דבר שכיח מאוד. כשאנחנו רואים בקבוק קוקה־קולה בסרט, אנחנו יודעים שהחברה שילמה על זה כסף. אבל אם רובוט משקר לאנשים, במיוחד לאוכלוסייה פגיעה ובהיקפים גדולים, הבעיה הופכת משמעותית והמחוקקים יצטרכו לחשוב על זה".

הרצוג סבור שמצב הזה לא רחוק. עם אלקסה של אמזון וסירי של אפל, הוא אומר, "אנחנו כבר באמצע הדרך לשם". קריאה דומה משמיע ד"ר מארק גולדפדר, מרצה בכיר בבית הספר למשפטים של אוניברסיטת אמורי באטלנטה, שהוא גם עורך דין ורב. "הבינה המלאכותית פה כדי להישאר, וזה אומר שאנחנו צריכים לא רק להבין איך היא עובדת, אלא איך היא מתקיימת לצד כל אספקט אחר בחיינו".

אתה מציע לתת לרובוטים מעמד משפטי. הוא יגיע עם חובות וזכויות?

"פרסונה משפטית לא קשורה למוסר, יכולת חישה או חיים. זה רק אומר שבמסגרת משפטית מסוימת יש לך זכויות וחובות משפטיות, כמו הזכות לתבוע ולהיתבע. השאלה אילו זכויות יש להעניק תלויה במערכת המשפטית שבה נמצאים. לא לכל הפרסונות המשפטיות יש אותן זכויות. לאדם ולתאגיד, למשל, יש זכויות שונות וציפיות שונות. אז אולי זה תלוי ברמת הרצון החופשי שהבינה המלאכותית תציג. ברמה הבסיסית זאת עשויה להיות הזכות לא להיפגע.

"אם וכאשר יגיעו רובוטים לרמה של רצון חופשי שאנחנו נוטים לקשר עם בני אדם, זאת תהיה לא רק קפיצה משפטית למעמד של פרסונה, אלא משהו שקרוב יותר לאנושיות, ואז נצטרך להתייחס אליהם כאל משהו קרוב לבני אדם. יש לי אחריות להתייחס לכל מה שנראה אנושי כאנושי. אנחנו עוד לא שם, אבל אנחנו לא רחוקים מאוד משם".